Python爬虫实战:爬取微博热搜

总之,使用Python爬取微博热搜榜单是一种获取有价值信息的方法。在实际应用中,我们需要根据具体情况选择合适的爬虫方法,并遵守相关法律法规和网站的使用规定。希望本文对你理解和使用Python爬取微博热搜榜单有所帮助。

前言

在开始之前,我们需要了解一些基本的爬虫知识。Python爬虫是一种自动化获取网页内容的技术,可以模拟浏览器行为,获取网页源代码,并从中提取所需的信息。在爬取微博热搜榜单时,我们需要发送HTTP请求获取网页源代码,然后使用正则表达式或者解析库对源代码进行解析和提取。

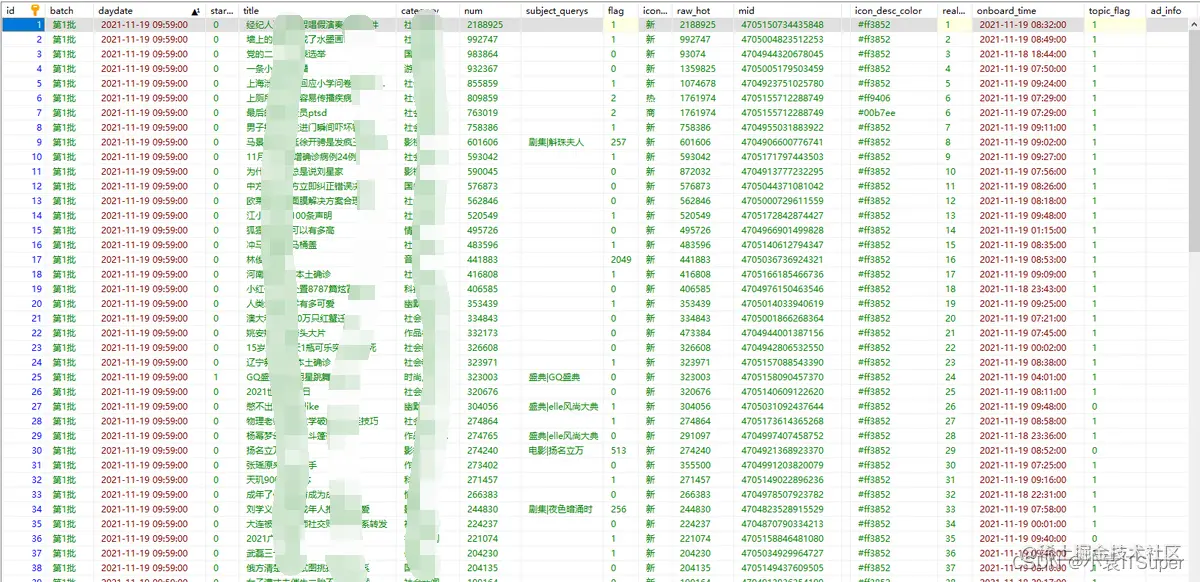

爬取目标(效果展示)

在使用Python进行爬虫的过程中,经常需要获取微博热搜榜单的数据。微博热搜榜单是一个非常有价值的信息源,可以了解当前社会热点事件和用户关注度。本文将介绍使用Python爬取微博热搜榜单的方法。

效果展示:

爬取的内容是:标题、榜单、热度值、新闻类型、时间戳、url地址等

准备工作

我用的是python3.8,VScode编辑器,所需的库有:requests、etree、time

开头导入所需用到的导入的库:

import requests # python基础爬虫库

from lxml import etree # 可以将网页转换为Elements对象

import time # 防止爬取过快可以睡眠一秒

建表:

CREATE TABLE "WB_HotList" (

"id" INT IDENTITY(1,1) PRIMARY key,

"batch" NVARCHAR(MAX),

"daydate" SMALLDATETIME,

"star_word" NVARCHAR(MAX),

"title" NVARCHAR(MAX),

"category" NVARCHAR(MAX),

"num" NVARCHAR(MAX),

"subject_querys" NVARCHAR(MAX),

"flag" NVARCHAR(MAX),

"icon_desc" NVARCHAR(MAX),

"raw_hot" NVARCHAR(MAX),

"mid" NVARCHAR(MAX),

"emoticon" NVARCHAR(MAX),

"icon_desc_color" NVARCHAR(MAX),

"realpos" NVARCHAR(MAX),

"onboard_time" SMALLDATETIME,

"topic_flag" NVARCHAR(MAX),

"ad_info" NVARCHAR(MAX),

"fun_word" NVARCHAR(MAX),

"note" NVARCHAR(MAX),

"rank" NVARCHAR(MAX),

"url" NVARCHAR(MAX)

)

为防止,字段给的不够,直接给个MAX!

代码分析

先讲讲我的整体思路在逐步分析:

- 第一步:发送请求,获取网页信息

- 第二步:解析数据,提取我们所需要的数据

- 第三步:添加入库批次号

- 第四步:把数据存入数据库

第一步

发送请求,获取网页信息

提供了数据的接口,所以我们直接访问接口就行,如下图(json格式):

# 接口地址:https://weibo.com/ajax/statuses/hot_band

def __init__(self) :

self.url = "https://weibo.com/ajax/statuses/hot_band"

self.headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36"}

# 发送请求,获取相应

def parse_url(self):

response = requests.get(self.url,headers=self.headers)

time.sleep(2) # 休息两秒

return response.content.decode()

第二步

解析数据,提取我们所需要的数据

接口中的数据格式化如下(只需提取我们所需要的):

for i in range(50):

ban_list = json_data['data']['band_list'][i]

batch = f'第{a}批'

try:

star_word = ban_list['star_word']

except Exception as e:

print(e)

try:

title = ban_list['word']

except Exception as e:

print(e)

try:

category = ban_list['category']

except Exception as e:

print(e)

try:

num = ban_list['num']

except Exception as e:

print(e)

try:

subject_querys = ban_list['subject_querys']

except Exception as e:

print(e)

try:

flag = ban_list['flag']

except Exception as e:

print(e)

try:

icon_desc = ban_list['icon_desc']

except Exception as e:

print(e)

try:

raw_hot = ban_list['raw_hot']

except Exception as e:

print(e)

try:

mid = ban_list['mid']

except Exception as e:

print(e)

try:

emoticon = ban_list['emoticon']

except Exception as e:

print(e)

try:

icon_desc_color = ban_list['icon_desc_color']

except Exception as e:

print(e)

try:

realpos = ban_list['realpos']

except Exception as e:

print(e)

try:

onboard_time = ban_list['onboard_time']

onboard_time = datetime.datetime.fromtimestamp(onboard_time)

except Exception as e:

print(e)

try:

topic_flag = ban_list['topic_flag']

except Exception as e:

print(e)

try:

ad_info = ban_list['ad_info']

except Exception as e:

print(e)

try:

fun_word = ban_list['fun_word']

except Exception as e:

print(e)

try:

note = ban_list['note']

except Exception as e:

print(e)

try:

rank = ban_list['rank'] + 1

except Exception as e:

print(e)

try:

url = json_data['data']['band_list'][i]['mblog']['text']

url = re.findall('href="(.*?)"',url)[0]

第三步

数据库的batch用于判断,每次插入的批次(50个一批),如果爬虫断了,写个方法还能接着上次的批次

如图:

# 把数据库batch列存入列表并返回(用于判断批次号)

def batch(self):

conn=pymssql.connect('.', 'sa', 'yuan427', 'test')

cursor=conn.cursor()

cursor.execute("select batch from WB_HotList") #向数据库发送SQL命令

rows=cursor.fetchall()

batchlist=[]

for list in rows:

batchlist.append(list[0])

return batchlist

第四步

把数据存入数据库

# 连接数据库服务,创建游标对象

db = pymssql.connect('.', 'sa', 'yuan427', 'test') #服务器名,账户,密码,数据库名

if db:

print("连接成功!")

cursor= db.cursor()

try:

# 插入sql语句

sql = "insert into test4(batch,daydate,star_word,title,category,num,subject_querys,flag,icon_desc,raw_hot,mid,emoticon,icon_desc_color,realpos,onboard_time, \

topic_flag,ad_info,fun_word,note,rank,url) values (%s,getdate(),%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s)"

# 执行插入操作

cursor.execute(sql,(batch,star_word,title,category,num,subject_querys,flag,icon_desc,raw_hot,mid,emoticon,icon_desc_color,realpos,onboard_time,topic_flag,ad_info, \

fun_word,note,rank,url))

db.commit()

print('成功载入......' )

except Exception as e:

db.rollback()

print(str(e))

# 关闭游标,断开数据库

cursor.close()

db.close()

完整代码

import requests,pymssql,time,json,re,datetime

from threading import Timer

class Spider:

def __init__(self) :

self.url = "https://weibo.com/ajax/statuses/hot_band"

self.headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36"}

# 发送请求,获取相应

def parse_url(self):

response = requests.get(self.url,headers=self.headers)

time.sleep(2)

return response.content.decode()

# 解析数据,入库

def parse_data(self,data,a):

json_data = json.loads(data)

# 连接数据库服务,创建游标对象

db = pymssql.connect('.', 'sa', 'yuan427', 'test') #服务器名,账户,密码,数据库名

cursor= db.cursor()

for i in range(50):

ban_list = json_data['data']['band_list'][i]

batch = f'第{a}批'

try:

star_word = ban_list['star_word']

except Exception as e:

print(e)

try:

title = ban_list['word']

except Exception as e:

print(e)

try:

category = ban_list['category']

except Exception as e:

print(e)

try:

num = ban_list['num']

except Exception as e:

print(e)

try:

subject_querys = ban_list['subject_querys']

except Exception as e:

print(e)

try:

flag = ban_list['flag']

except Exception as e:

print(e)

try:

icon_desc = ban_list['icon_desc']

except Exception as e:

print(e)

try:

raw_hot = ban_list['raw_hot']

except Exception as e:

print(e)

try:

mid = ban_list['mid']

except Exception as e:

print(e)

try:

emoticon = ban_list['emoticon']

except Exception as e:

print(e)

try:

icon_desc_color = ban_list['icon_desc_color']

except Exception as e:

print(e)

try:

realpos = ban_list['realpos']

except Exception as e:

print(e)

try:

onboard_time = ban_list['onboard_time']

onboard_time = datetime.datetime.fromtimestamp(onboard_time)

except Exception as e:

print(e)

try:

topic_flag = ban_list['topic_flag']

except Exception as e:

print(e)

try:

ad_info = ban_list['ad_info']

except Exception as e:

print(e)

try:

fun_word = ban_list['fun_word']

except Exception as e:

print(e)

try:

note = ban_list['note']

except Exception as e:

print(e)

try:

rank = ban_list['rank'] + 1

except Exception as e:

print(e)

try:

url = json_data['data']['band_list'][i]['mblog']['text']

url = re.findall('href="(.*?)"',url)[0]

except Exception as e:

print(e)

try:

# 插入sql语句

sql = "insert into test4(batch,daydate,star_word,title,category,num,subject_querys,flag,icon_desc,raw_hot,mid,emoticon,icon_desc_color,realpos,onboard_time, \

topic_flag,ad_info,fun_word,note,rank,url) values (%s,getdate(),%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s)"

# 执行插入操作

cursor.execute(sql,(batch,star_word,title,category,num,subject_querys,flag,icon_desc,raw_hot,mid,emoticon,icon_desc_color,realpos,onboard_time,topic_flag,ad_info, \

fun_word,note,rank,url))

db.commit()

print('成功载入......' )

except Exception as e:

db.rollback()

print(str(e))

# 关闭游标,断开数据库

cursor.close()

db.close()

# 把数据库batch列存入列表并返回(用于判断批次号)

def batch(self):

conn=pymssql.connect('.', 'sa', 'yuan427', 'test')

cursor=conn.cursor()

cursor.execute("select batch from WB_HotList") #向数据库发送SQL命令

rows=cursor.fetchall()

batchlist=[]

for list in rows:

batchlist.append(list[0])

return batchlist

# 实现主要逻辑

def run(self, a):

# 根据数据库批次号给定a的值

batchlist = self.batch()

if len(batchlist) != 0:

batch = batchlist[len(batchlist) -1]

a = re.findall('第(.*?)批',batch)

a = int(a[0]) + 1

data = self.parse_url()

self.parse_data(data,a)

a +=1

# 定时调用

t = Timer(1800, self.run, (a, )) # 1800表示1800秒,半小时调用一次

t.start()

if __name__ == "__main__":

spider = Spider()

spider.run(1)

启动

因为需要一直运行,所以就在 cmd 挂着

运行成功后,去数据库看看:

总结

总之,使用Python爬取微博热搜榜单是一种获取有价值信息的方法。在实际应用中,我们需要根据具体情况选择合适的爬虫方法,并遵守相关法律法规和网站的使用规定。希望本文对你理解和使用Python爬取微博热搜榜单有所帮助。

如果你对Python感兴趣,想要学习python,这里给大家分享一份Python全套学习资料,都是我自己学习时整理的,希望可以帮到你,一起加油!

😝有需要的小伙伴,可以点击下方链接免费领取或者V扫描下方二维码免费领取🆓

Python全套学习资料

1️⃣零基础入门

① 学习路线

对于从来没有接触过Python的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

② 路线对应学习视频

还有很多适合0基础入门的学习视频,有了这些视频,轻轻松松上手Python~

③练习题

每节视频课后,都有对应的练习题哦,可以检验学习成果哈哈!

2️⃣国内外Python书籍、文档

① 文档和书籍资料

3️⃣Python工具包+项目源码合集

①Python工具包

学习Python常用的开发软件都在这里了!每个都有详细的安装教程,保证你可以安装成功哦!

②Python实战案例

光学理论是没用的,要学会跟着一起敲代码,动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。100+实战案例源码等你来拿!

③Python小游戏源码

如果觉得上面的实战案例有点枯燥,可以试试自己用Python编写小游戏,让你的学习过程中增添一点趣味!

4️⃣Python面试题

我们学会了Python之后,有了技能就可以出去找工作啦!下面这些面试题是都来自阿里、腾讯、字节等一线互联网大厂,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

5️⃣Python兼职渠道

而且学会Python以后,还可以在各大兼职平台接单赚钱,各种兼职渠道+兼职注意事项+如何和客户沟通,我都整理成文档了。

上述所有资料 ⚡️ ,朋友们如果有需要的,可以扫描下方👇👇👇二维码免费领取🆓

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)