一文了解TOF、三角法测距和相位测距以及FMCW激光雷达测距原理

来源:光学追光者激光雷达根据原理可以分为TOF(飞行时间),三角法测距和相位测距三种方式。三角法测距为三角测距法是利用相似三角形本地可以测得透镜中心和照射到CMOS/CCD上的距离,就可以得到物距,本地的分辨率l决定了探测物体的分辨率。因此当物距越大,探测精度越低。因此该方法测距较短且需要大面积的光电探测器。TOF为目前大多数的自动驾驶采用的雷达方案,通过发射脉冲激光,计算脉冲激光经过目标并反射回

来源:光学追光者

激光雷达根据原理可以分为TOF(飞行时间),三角法测距和相位测距三种方式。

三角法测距为

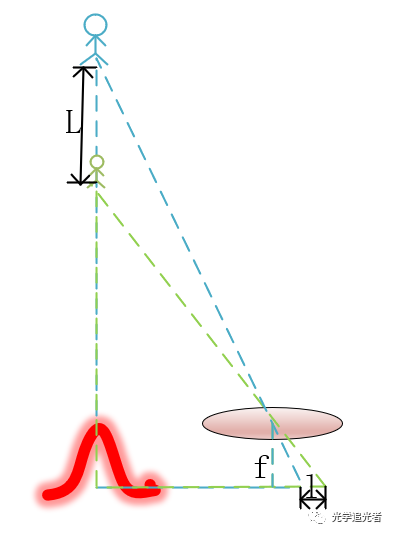

三角测距法是利用相似三角形本地可以测得透镜中心和照射到CMOS/CCD上的距离,就可以得到物距,本地的分辨率l决定了探测物体的分辨率。因此当物距越大,探测精度越低。因此该方法测距较短且需要大面积的光电探测器。

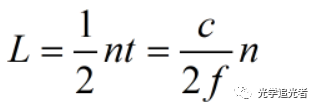

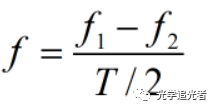

TOF为目前大多数的自动驾驶采用的雷达方案,通过发射脉冲激光,计算脉冲激光经过目标并反射回探测器的时间,即飞行时间。飞行时间等于脉冲数n和脉冲间隔t的乘积,距离就等于飞行时间和速度的乘积,如下面公式所示,f为脉冲频率。

这种方式简单直接,测距的精度不随距离增加而恶化,但是由于光速快,短距下对器件的响应时间要求高。

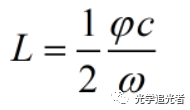

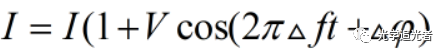

TOF另一种精度更高的测距方式为测量调制信号和初始信号的相位差。对激光器发出的光进行幅度调制,调制信号经过反射后进行探测,检测该回波信号的相位和原始相位差,根据已知的调制信号的角频率即可获得距离

由于相位检测只能在一个2pi区间内,因此测距存在不准确性,为了提高测距的准确度,需要使用不同角频率的调制信号多次测量,测量效率低。

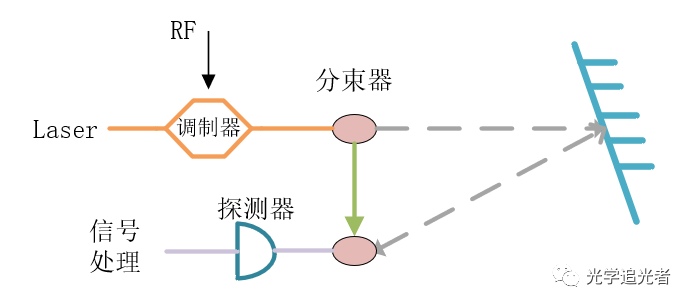

FMCW为Frequency modulated continuous wave,即调频连续波,从名字就可知在测距过程中发射的频率是变化且在时间上连续的。

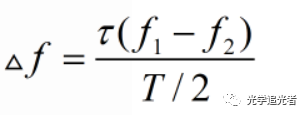

上图为相干探测过程。RF信号频率在一定范围内改变,通常为三角波或者锯齿波。调制器将RF信号调制到光频域上,输出的频率范围假设为f1和f2,三角波周期为T,则输出频率为

分束器分出一部分光用作参考光,剩余部分经过放大器向空间发射,经过物体表面反射回来,和参考光合束后在PD中拍频。通常受限于带宽,和频被滤掉,剩余差频以及相位关系。

差频与回波信号相对于参考信号的延时有关。从上述公式以及相位测距的公式对比,可以发现FMCW就是通过将相位差转化为频率差严格的测出相位差(延时),而探测器很容易测出差频的频率。FMCW的优势明显,测量精度高,抗干扰能力强,同时也可以测速度,拍频后频率低,易于信号处理,而且不像脉冲激光器需要高功率打出去,FMCW的峰值功率为百mW量级,比TOF低四个数量级,比较安全。

目前能够提供基于FMCW的激光雷达应该只有Aeva, Mobieye和Aurora,而且均没有量产。目前FMCW激光雷达主要的难点在于使用的是1.5um波长的光,在空气中传播损耗大,且受天气影响严重;基于硅芯片的FMCW需要调制信号,对调制器的线性度要求较高,而且成本也是一大问题,硅光始终没有大规模应用,封测成本都比较高。

参考:

[1]谈谈激光雷达的测距原理-三角/脉冲/相位/DTOF/ITOF... - 知乎 (zhihu.com)

[2]陶敏,光学相控阵全固态激光雷达驱动与控制技术研究

[3]FMCW激光雷达科普(下):主要挑战、前景及市场格局_九章智驾的博客-CSDN博客

—END—高效学习3D视觉三部曲

第一步 加入行业交流群,保持技术的先进性

目前工坊已经建立了3D视觉方向多个社群,包括SLAM、工业3D视觉、自动驾驶方向,细分群包括:[工业方向]三维点云、结构光、机械臂、缺陷检测、三维测量、TOF、相机标定、综合群;[SLAM方向]多传感器融合、ORB-SLAM、激光SLAM、机器人导航、RTK|GPS|UWB等传感器交流群、SLAM综合讨论群;[自动驾驶方向]深度估计、Transformer、毫米波|激光雷达|视觉摄像头传感器讨论群、多传感器标定、自动驾驶综合群等。[三维重建方向]NeRF、colmap、OpenMVS等。除了这些,还有求职、硬件选型、视觉产品落地等交流群。大家可以添加小助理微信: cv3d007,备注:加群+方向+学校|公司, 小助理会拉你入群。

第二步 加入知识星球,问题及时得到解答

针对3D视觉领域的视频课程(三维重建、三维点云、结构光、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、源码分享、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答等进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业、项目对接为一体的铁杆粉丝聚集区,6000+星球成员为创造更好的AI世界共同进步,知识星球入口:「3D视觉从入门到精通」

学习3D视觉核心技术,扫描查看,3天内无条件退款

第三步 系统学习3D视觉,对模块知识体系,深刻理解并运行

如果大家对3D视觉某一个细分方向想系统学习[从理论、代码到实战],推荐3D视觉精品课程学习网址:www.3dcver.com

基础课程:

[1]面向三维视觉算法的C++重要模块精讲:从零基础入门到进阶

工业3D视觉方向课程:

SLAM方向课程:

[1]如何高效学习基于LeGo-LOAM框架的激光SLAM?

[1]彻底剖析激光-视觉-IMU-GPS融合SLAM算法:理论推导、代码讲解和实战

[2](第二期)彻底搞懂基于LOAM框架的3D激光SLAM:源码剖析到算法优化

[3]彻底搞懂视觉-惯性SLAM:VINS-Fusion原理精讲与源码剖析

[4]彻底剖析室内、室外激光SLAM关键算法和实战(cartographer+LOAM+LIO-SAM)

视觉三维重建

[1]彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进)

自动驾驶方向课程:

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)