揭秘大模型提升秘诀:RAG系统中的文本分块策略

LangChain 还预定义了其他编程语言(如 Go、C++、Java)等的分割符列表,方便用户快速定义新的文本切块类。如果需要处理未提供的文本格式,可以参照已有的类实现。自定义示例:创建一个用于切分 Java 代码的文本切块类。"\n\n", # 空行"\n", # 换行", # 语句结束" ", # 空格"" # 无分隔符text = "..." # 待处理的 Java 代码print(doc

随着大语言模型(Large Language Models)的迅猛发展,基于检索增强生成(Retrieval-Augmented Generation,RAG)的技术在各种应用场景中展现出了强大的潜力。RAG系统通过将外部知识库中的相关信息检索并结合大模型的生成能力,能够提供更加准确和丰富的回答。在这一过程中,构建高质量的向量数据库是关键步骤,而文本分块策略则直接影响了向量数据库的构建质量和大模型的输出准确率。本文将全面深入地阐述文本分块在RAG系统中的重要性,探讨其背景、必要性,以及实践中的具体方案和优化策略。

一、背景与重要性

1.1、RAG系统的工作原理

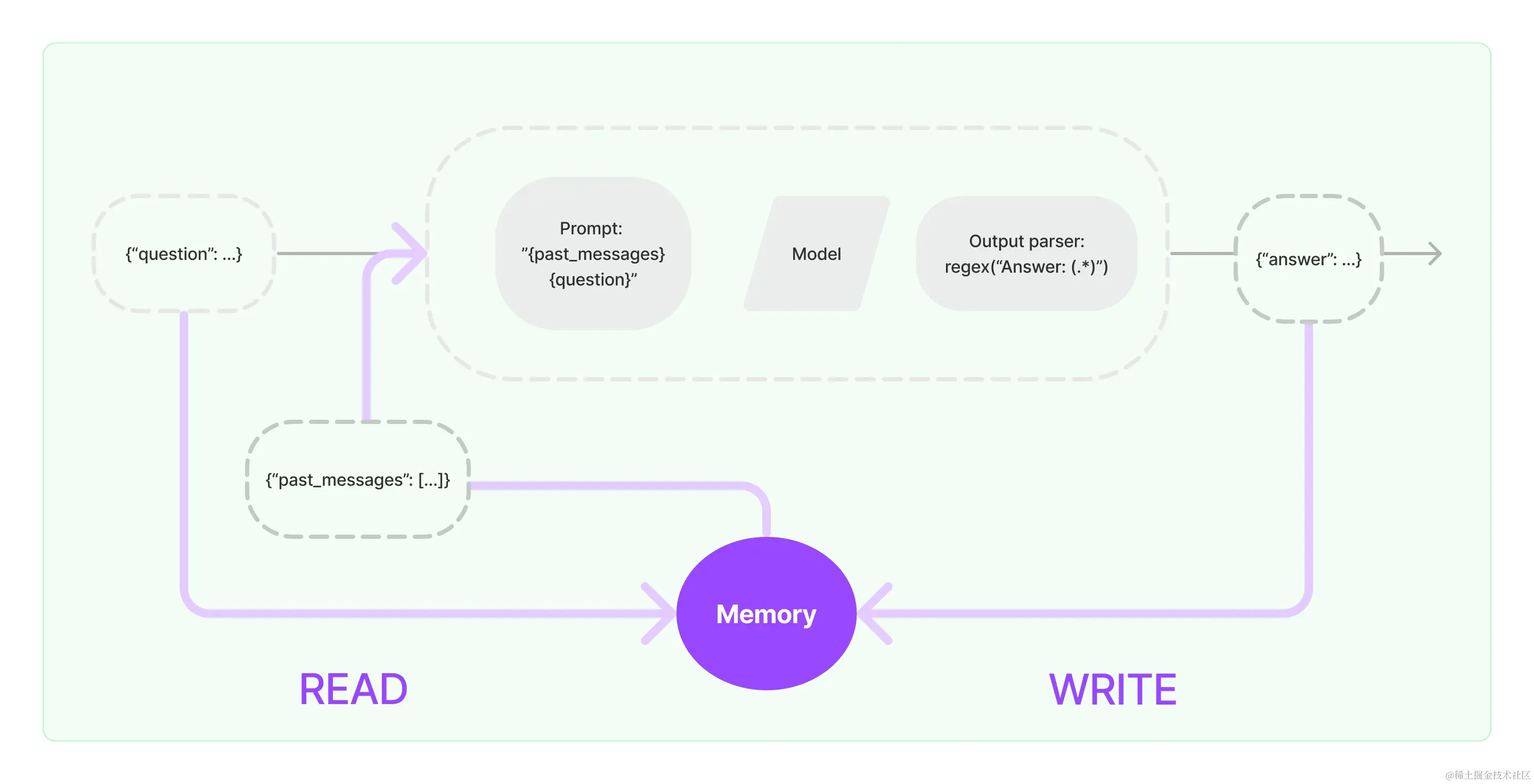

RAG系统结合了信息检索和生成式模型的优势。它首先从知识库中检索与用户查询相关的文本内容,然后将这些内容与用户的输入一同传递给大语言模型,以生成更加准确和上下文相关的回答。这个过程要求知识库中的文本能够被高效检索和准确匹配,这就涉及到文本的向量化和向量数据库的构建。

1.2、文本分块的必要性

为了构建向量数据库,需要对大量的文本进行向量化。然而,直接对长文本进行向量化存在诸多挑战,如语义信息的稀释、计算资源的耗费以及检索效率的降低。因此,将长文本进行合理的分块处理,成为构建高效向量数据库的前提。合适的文本分块策略可以提高检索准确率,确保召回的内容与用户的查询意图更加契合,进而提升大模型生成答案的质量。

二、为什么要进行文本分块

2.1 长文本向量化的挑战

在基于 Transformer 架构的向量化模型中,每个词汇都会被映射为一个高维向量。为了表示整段文本的语义,我们通常采用对词向量取平均,或使用特殊标记(如 [CLS])位置的向量作为整体表示。然而,当直接对过长的文本进行向量化时,会面临以下挑战:

- 语义信息稀释:长文本往往涵盖多个主题或观点,整体向量难以准确捕捉细节语义,导致语义信息被稀释,无法充分体现文本的核心内容。

- 计算开销增大:处理长文本需要更多的计算资源和存储空间,增加了模型的计算复杂度,影响系统的性能和效率。

- 检索效率降低:过长的向量在检索过程中可能会降低匹配精度,导致检索结果的相关性下降,同时也会降低检索的速度和效率。

2.2 提升检索和生成质量的必要性

为了克服上述挑战,合理的文本分块策略显得尤为重要。通过对文本进行适当的切分,可以有效提升检索和生成的质量:

- 提高检索准确率:将文本分块后,得到的文本片段具有更精细的粒度,能够更准确地匹配用户的查询意图,提升检索结果的相关性和准确度。

- 优化系统性能:缩短单个文本块的长度,减少了模型在向量化和检索过程中的计算和存储开销,提高了系统的处理效率和响应速度。

- 增强大模型的回答质量:为大语言模型提供更相关和精炼的文本块,有助于模型更好地理解语境,从而生成更准确、连贯和贴切的回答。

通过对文本进行合理的分块,不仅可以提高向量化过程中的语义表达能力,还能在检索阶段取得更高的匹配精度,最终使得 RAG 系统能够为用户提供更优质的服务。

三、文本分块策略对大模型输出的影响

在大模型 RAG 场景中,为了构建高效的向量数据库,我们需要对包含丰富知识的长文本进行合理的切分,然后通过文本向量化模型处理后存入数据库。虽然文本切分看似简单,但它对大模型最终回答的质量有着深远的影响。

3.1文本分块过长的影响

在构建 RAG(Retrieval-Augmented Generation)系统时,文本分块的长度对大模型的输出质量有着至关重要的影响。过长的文本块会带来一系列问题:

1)语义模糊:当文本块过长时,在向量化过程中,细节语义信息容易被平均化或淡化。这是因为向量化模型需要将大量的词汇信息压缩成固定长度的向量表示,导致无法精准捕捉文本的核心主题和关键细节。结果就是,生成的向量难以代表文本的重要内容,降低了模型对文本理解的准确性。

2)降低召回精度:在检索阶段,系统需要根据用户的查询从向量数据库中检索相关文本。过长的文本块可能涵盖多个主题或观点,增加了语义的复杂性,导致检索模型难以准确匹配用户的查询意图。这样一来,召回的文本相关性下降,影响了大模型生成答案的质量。

3)输入受限:大语言模型(LLM)对输入长度有严格的限制。过长的文本块会占据更多的输入空间,减少可供输入的大模型的文本块数量。这限制了模型能够获取的信息广度,可能导致遗漏重要的上下文或相关信息,影响最终的回答效果。

3.2文本分块过短的影响

相反,过短的文本块也会对大模型的输出产生不利影响,具体表现为:

1)上下文缺失:短文本块可能缺乏必要的上下文信息。上下文对于理解语言的意义至关重要,缺乏上下文的文本块会让模型难以准确理解文本的含义,导致生成的回答不完整或偏离主题。

2)主题信息丢失:段落或章节级别的主题信息需要一定的文本长度来表达。过短的文本块可能只包含片段信息,无法完整传达主要观点或核心概念,影响模型对整体内容的把握。

3)碎片化问题:大量的短文本块会导致信息碎片化,增加检索和处理的复杂度。系统需要处理更多的文本块,增加了计算和存储的开销。同时,过多的碎片化信息可能会干扰模型的判断,降低系统性能和回答质量。

通过上述分析,我们可以得出结论:合理的文本分块策略是提升 RAG 系统性能和大模型回答质量的关键。为了在实际应用中取得最佳效果,需要在以下方面进行权衡和优化:

1)根据文本内容选择切分策略:不同类型的文本适合不同的切分方法。

- 逻辑紧密的文本:对于论文、技术文档等段落内逻辑紧密的文本,应尽量保持段落的完整性,避免过度切分,以保留完整的语义和逻辑结构。

- 语义独立的文本:对于法规条款、产品说明书等句子间逻辑相对独立的文本,可以按照句子进行切分。这种方式有助于精确匹配特定的查询内容,提高检索的准确性。

2)考虑向量化模型的性能:评估所使用的向量化模型对于不同长度文本的处理能力。

- 长文本处理:如果向量化模型在处理长文本时容易丢失信息,应适当缩短文本块的长度,以提高向量表示的精确度。

- 短文本优化:对于能够有效处理短文本的模型,可以适当切分文本,但要注意保留必要的上下文信息。

3)关注大模型的输入限制:大语言模型对输入长度有一定的限制,需要确保召回的文本块能够全部输入模型。

- 输入长度优化:在切分文本块时,控制每个块的长度,使其既包含完整的语义信息,又不超过模型的输入限制。

- 信息覆盖:确保切分后的文本块能够覆盖知识库中的关键信息,避免遗漏重要内容。

4)实验与迭代:没有一种放之四海而皆准的最佳实践,需要根据具体的应用场景进行实验和调整。

- 性能评估:通过实验评估不同切分策略对检索准确性和生成质量的影响,从而选择最适合的方案。

- 持续优化:根据模型的表现和用户反馈,不断优化切分策略,提升系统的整体性能。

合理的文本分块策略在 RAG 系统中扮演着至关重要的角色。它直接影响向量数据库的构建质量和检索效果,进而影响大模型生成答案的准确性和可靠性。在实际应用中,需要根据文本的特点、向量化模型的性能以及大模型的输入限制,综合考虑,制定最适合的切分方案。

四、常见的文本分块策略

在 RAG(Retrieval-Augmented Generation,检索增强生成)系统中,文本分块策略的选择对系统性能和大模型的生成质量有着重要影响。合理的文本分块能提高检索准确性,并为大模型生成提供更好的上下文支持。下面,我们将深入探讨几种常见的文本分块方法及其应用场景。

常用的文本分块方法包括:固定大小分块、基于NTLK分块、特殊格式分块、深度学习模型分块、智能体式分块。

4.1、固定大小文本切块

固定大小文本切块是最简单直观的文本分块方法。它按照预先设定的固定长度,将文本划分为若干块。这种方法实现起来相对容易,但在实际应用中,需要注意以下几点:

4.1.1 问题与挑战

- 上下文割裂:简单地按照固定字符数截断文本,可能会打断句子或段落,导致上下文信息丢失。这会影响后续的文本向量化效果和语义理解。

- 语义完整性受损:文本块可能包含不完整的句子或思想,影响检索阶段的匹配精度,以及大模型生成回答的质量。

4.1.2 改进方法

为了解决上述问题,可以对固定大小文本切块进行优化:

- 引入重叠:在相邻文本块之间引入一定的重叠部分,确保上下文的连贯性。比如,每个文本块与前一个块有 50 个字符的重叠。这有助于保留句子的完整性和段落的连贯性。

- 智能截断:在切分文本时,尽量选择在标点符号或段落结束处进行截断,而不是严格按照字符数。这可以避免打断句子,保持语义的完整性。

4.1.3 实践工具:LangChain 的 RecursiveCharacterTextSplitter

大模型应用开发框架 LangChain 提供了 RecursiveCharacterTextSplitter,优化了固定大小文本切块的缺陷,推荐在通用文本处理中使用。

使用示例:

from langchain.text_splitter import RecursiveCharacterTextSplitter

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=200,

chunk_overlap=50,

length_function=len,

separators=["\n", "。", ""]

)

text = "..." # 待处理的文本

texts = text_splitter.create_documents([text])

for doc in texts:

print(doc)参数说明:

- chunk_size:文本块的最大长度(如 200 个字符)。

- chunk_overlap:相邻文本块之间的重叠长度(如 50 个字符)。

- length_function:用于计算文本长度的函数,默认为 len。

- separators:定义了一组分割符列表,用于在切分文本时优先选择合适的位置。

工作原理:

RecursiveCharacterTextSplitter 按照 separators 中的分割符顺序,递归地对文本进行切分:

- 初步切分:使用第一个分割符(如 "\n",表示段落分隔)对文本进行初步切分。

- 检查块大小:如果得到的文本块长度超过了 chunk_size,则使用下一个分割符(如 "。",表示句子分隔)进一步切分。

- 递归处理:依次使用剩余的分割符,直到文本块长度符合要求或无法再切分。

- 合并块:如果相邻的文本块合并后长度不超过 chunk_size,则进行合并,确保块的长度尽可能接近 chunk_size,同时保留上下文完整性。

4.2基于 NLTK 的文本切块

NLTK(Natural Language Toolkit) 是广泛使用的 Python 自然语言处理库,提供了丰富的文本处理功能。其中,sent_tokenize 方法可用于自动将文本切分为句子。

4.2.1 原理

sent_tokenize 基于论文《Unsupervised Multilingual Sentence Boundary Detection》的方法,使用无监督算法为缩写词、搭配词和句子开头的词建立模型,然后利用这些模型识别句子边界。这种方法在多种语言(主要是欧洲语言)上都取得了良好效果。

4.2.2 中文处理的注意事项

- 预训练模型缺失:NLTK 官方并未提供中文分句模型的预训练权重,需要用户自行训练。

- 训练接口可用:NLTK 提供了训练接口,用户可以基于自己的中文语料库训练分句模型。

4.2.3 在 LangChain 中的应用

LangChain 集成了 NLTK 的文本切分功能,方便用户直接调用。

使用示例:

from langchain.text_splitter import NLTKTextSplitter

text_splitter = NLTKTextSplitter()

text = "..." # 待处理的文本

texts = text_splitter.split_text(text)

for doc in texts:

print(doc)4.2.4 扩展:基于 spaCy 的文本切块

spaCy 是另一款强大的自然语言处理库,具备更高级的语言分析能力。LangChain 也集成了 spaCy 的文本切分方法。

使用方法:

只需将 NLTKTextSplitter 替换为 SpacyTextSplitter:

from langchain.text_splitter import SpacyTextSplitter

text_splitter = SpacyTextSplitter()

text = "..." # 待处理的文本

texts = text_splitter.split_text(text)

for doc in texts:

print(doc)提示:使用 spaCy 时,需要先下载对应语言的模型。例如,处理中文文本时,需要下载中文模型包。

4.3特殊格式文本切块

在实际应用中,常常需要处理具有特殊内在结构的文本,如 HTML、Markdown、LaTeX、代码文件 等。这些文本的结构信息对于理解其内容至关重要,简单的文本切分方法可能会破坏其原有结构,导致上下文信息丢失。

4.3.1 处理原则

- 保留结构信息:在切分文本时,应尽量保留其内在的结构,如标签、标题、代码块等。

- 减少上下文损失:避免在关键位置切分文本,以免丢失重要的上下文信息。

4.3.2 LangChain 提供的特殊文本切块方法

LangChain 为用户提供了针对多种特殊格式文本的切块类,方便用户处理不同类型的文本。

表 4-1 LangChain 提供的特殊文本切块方法

4.3.3 使用示例

以处理 Markdown 文本为例:

from langchain.text_splitter import MarkdownTextSplitter

text_splitter = MarkdownTextSplitter()

text = "..." # 待处理的 Markdown 文本

texts = text_splitter.split_text(text)

for doc in texts:

print(doc)4.3.4 工作原理

这些特殊文本切块类针对不同的文本格式,预设了适合的分割符列表,然后调用 RecursiveCharacterTextSplitter 进行进一步的切分。例如:

- PythonCodeTextSplitter:针对 Python 代码的结构,设置适合的分隔符,如函数定义、类定义、注释等。

- MarkdownTextSplitter:根据 Markdown 的结构,如标题、列表、段落等,进行切分。

- LatexTextSplitter:识别 LaTeX 文档的章节、公式、环境等进行切分。

- HTMLHeaderTextSplitter:针对 HTML 文档的标签结构,按照元素层级进行切分。

4.3.5 自定义扩展

LangChain 还预定义了其他编程语言(如 Go、C++、Java)等的分割符列表,方便用户快速定义新的文本切块类。如果需要处理未提供的文本格式,可以参照已有的类实现。

自定义示例:创建一个用于切分 Java 代码的文本切块类。

from langchain.text_splitter import RecursiveCharacterTextSplitter

class JavaCodeTextSplitter(RecursiveCharacterTextSplitter):

def __init__(self, **kwargs):

separators = [

"\n\n", # 空行

"\n", # 换行

";", # 语句结束

" ", # 空格

"" # 无分隔符

]

super().__init__(separators=separators, **kwargs)

text_splitter = JavaCodeTextSplitter(chunk_size=200, chunk_overlap=50)

text = "..." # 待处理的 Java 代码

texts = text_splitter.split_text(text)

for doc in texts:

print(doc)通过自定义分割符列表和参数设置,可以灵活地适应不同格式文本的切分需求。

4.4 基于深度学习模型的文本切块

在自然语言处理领域,深度学习模型的应用极大地推动了文本处理技术的发展。在文本切分方面,研究者们利用预训练模型的强大表示能力,提出了多种基于深度学习的文本切分方法,以提高切分的准确性和效率。

4.4.1、朴素的基于BERT的文本切分方法

为了使BERT模型能够学习两个句子之间的关系,在其预训练过程中设计了一个二分类任务:同时向BERT中输入两个句子,预测第二个句子是否是第一个句子的下一句。基于这一思想,我们可以设计一种最朴素的文本切分方法,其中最小的切分单位是句子。

具体而言,在完整的文本上,采用滑动窗口的方式,将相邻的两个句子分别输入BERT模型进行二分类预测。如果预测得分较低,说明这两个句子之间的语义关系较弱,此处可作为文本的切分点。然而,这种方法存在一定的局限性:

- 上下文信息有限:在判断切分点时,只考虑了前后两个相邻句子,未利用更长距离的文本信息,可能导致切分不准确。

- 计算效率低:需要对文本中的每对相邻句子进行预测,计算量较大,难以应对大规模文本处理的需求。

图4-3 基于BERT的朴素文本切分方法

4.4.2、Cross-Segment模型:引入更长的上下文依赖

针对上述方法的不足,Lukasik等人在论文《Text Segmentation by Cross Segment Attention》中提出了Cross-Segment模型。该模型的核心是充分利用更长的上下文信息,同时提升预测效率。

主要步骤:

- 句子向量化:利用BERT模型分别获取每个句子的向量表示,保留句子的语义信息。

- 跨段落预测:将连续的多个句子的向量表示同时输入到另一个BERT或LSTM模型中,一次性预测每个句子是否为文本分段的边界。

这种方法的优势在于:

- 综合考虑上下文:通过同时处理多个句子,模型能够捕获更长距离的依赖关系,提高切分的准确性。

- 提高效率:相比逐一预测相邻句子的方式,批量处理多个句子能够提升计算效率。

4.4.3、SeqModel模型:自适应滑动窗口与上下文建模

虽然Cross-Segment模型引入了更长的上下文,但在句子向量化过程中,仍是对每个句子独立进行的,未充分建模句子间的复杂依赖关系。为此,Zhang等人在论文《Sequence Model with Self-Adaptive Sliding Window for Efficient Spoken Document Segmentation》中提出了SeqModel模型,对文本切分方法进行了进一步改进。

SeqModel的特点:

- 同时编码多个句子:利用BERT对连续的多个句子进行联合编码,直接建模句子间的依赖关系,获取包含上下文信息的句子表示。

- 预测切分边界:在获得句子的上下文表示后,模型预测每个句子后是否需要进行文本分割。

- 自适应滑动窗口:引入了自适应滑动窗口的方法,根据文本内容动态调整窗口大小,在不牺牲准确性的前提下,加快推理速度。

这种方法不仅提高了切分的准确性,还使得模型在处理长文本时具有更高的效率。

图4-5 SeqModel示意图

4.4.4、SeqModel模型的应用与实现

值得关注的是,SeqModel模型的预训练权重已经在「魔搭社区(ModelScope)」上公开发布,支持中文文本的处理。这为开发者在实际项目中应用SeqModel模型,提供了便利的条件。

使用方法示例:

from modelscope.outputs import OutputKeys

from modelscope.pipelines import pipeline

from modelscope.utils.constant import Tasks

# 初始化文本分割任务的pipeline

p = pipeline(task=Tasks.document_segmentation, model='damo/nlp_bert_document-segmentation_chinese-base')

# 输入需要分割的长文本

documents = '这里输入您需要分割的长文本内容'

# 执行文本分割

result = p(documents=documents)

# 输出分割后的文本结果

print(result[OutputKeys.TEXT])模型下载地址:https://modelscope.cn/models/damo/nlp_bert_document-segmentation_chinese-base/summary

通过该模型,开发者可以高效地对中文文档进行文本切分,为后续的文本分析、信息检索、问答系统等应用打下坚实的基础。

基于深度学习模型的文本切分方法,利用了预训练模型对语言的深层次理解,从最初的朴素方法到Cross-Segment,再到SeqModel模型的不断改进:

- 朴素方法:以句子为最小单位,利用BERT预测相邻句子的联系,但上下文考虑有限,效率较低。

- Cross-Segment模型:引入更长的上下文,批量预测切分点,提高了准确性和效率。

- SeqModel模型:同时编码多个句子,建模句子间的依赖关系,采用自适应滑动窗口,进一步提升性能。

这些方法的演进,体现了研究者们在文本切分领域的不懈探索和创新。通过选择合适的模型和方法,我们可以更精确地对文本进行切分,提高下游任务的效果,满足多样化的实际应用需求。

4.5基于智能体的文本切块

智能体式分块代表着文本分块领域的前沿方向,它摒弃了静态的、基于规则的方法,转而采用动态的、基于AI的策略。这种方法利用智能体(例如训练好的机器学习模型)来自动识别文本中的语义边界,并根据任务需求、文本内容和上下文动态调整分块策略,实现更精细、更灵活的文本分割。

4.5.1 技术特点

- 动态适应性:区别于固定长度或基于标点符号等静态方法,智能体式分块能够根据文本内容和任务目标动态调整分块策略。例如,面对一篇结构复杂的学术论文,智能体可以识别出章节、段落、公式等不同层级的语义单元,并据此进行分块;而处理一篇新闻报道时,则可以更侧重于事件的时间线和关键信息点进行划分。这种灵活性使其能够适应各种类型的文本和不同的应用场景。

- 智能优化:智能体可以通过持续学习和优化,不断提升分块的精准度和效率。通过在大量的文本数据上进行训练,智能体可以学习到复杂的语义模式和最佳分块策略,从而在实际应用中实现更高的检索准确率和生成质量。

- 上下文感知:智能体不仅关注单个文本块的语义完整性,更注重在全局范围内理解文本的上下文信息。这使得生成的文本块之间能够保持语义连贯性,避免信息割裂,从而更好地支持LLM的理解和生成。

2.5.2 工作原理

智能体式分块通常包含以下几个关键步骤:

- 深度语义分析:利用预训练的语言模型(如BERT、RoBERTa、GPT等)对文本进行深度语义分析,捕捉词义、句法结构和上下文信息,识别潜在的语义边界。

- 边界预测:基于语义分析的结果,训练一个专门的边界预测模型,该模型可以是一个序列标注模型或者一个分类模型,用于预测每个词或句子是否应该作为分块边界。

- 分块生成:根据边界预测的结果,将文本分割成若干个语义连贯的片段,并进行必要的后续处理,例如去除冗余信息或添加必要的上下文信息。

2.5.3 在RAG中的应用

智能体式分块在RAG系统中具有显著优势:

- 提升检索精准度:通过更精细的语义理解和动态分块,智能体可以生成与用户查询高度相关的文本片段,提高检索的精准度和召回率。

- 增强生成质量:为LLM提供更相关、更连贯的文本片段,有助于其生成更准确、更流畅、更具信息量的回答。

- 个性化定制:智能体可以根据用户的特定需求和偏好进行定制化分块,提供更个性化的检索和生成体验。

虽然智能体式分块在性能和灵活性方面具有显著优势,但也面临着一些挑战,例如训练数据的获取和模型的复杂度。随着技术的不断发展,相信这些挑战将逐步得到克服,智能体式分块也将成为RAG系统中不可或缺的核心组件。

这五种分块方法各有优势和应用场景。固定大小分块和递归式分块提供了基础且直观的分块策略,基于文档的分块保持了文档的结构完整性,而语义式分块和智能体式分块则分别从语义层面和智能优化的角度提供了更为高级的分块解决方案。在实际应用中,选择合适的分块方法需要根据具体的任务需求、文本类型和期望的处理效果来决定。

在选择分块方法时,需要根据具体的应用需求、文本类型和可用资源进行综合考虑,以实现最佳的性能和效果。

五、文本分块的优化策略

在构建高效的 RAG(Retrieval-Augmented Generation)系统时,文本分块策略的优化对提升系统性能和大模型的回答质量至关重要。合理的文本分块能够在保持语义完整性的同时,满足向量化模型和大模型对输入的要求。下面,我们将详细探讨如何优化文本分块策略,以发挥 RAG 系统的最大潜能。

5.1保持语义完整性

5.1.1 避免句子拆分

在文本切分过程中,应尽量避免将句子拆分。句子是表达完整语义的基本单位,拆分句子可能导致语义破碎,影响向量化表示的准确性和模型对文本的理解。例如,句子中包含的主谓宾结构或修饰关系在被截断后,会失去原有的含义,使得模型难以准确捕捉文本的核心内容。

实践建议:

- 按标点切分:使用句号、问号、感叹号等标点符号作为切分点,确保每个文本块包含完整的句子。

- 分割符的优先级:在设定分割符时,将句子结束符号置于高优先级,保证切分过程中优先考虑句子边界。

5.1.2 考虑段落关联性

除了句子层面,段落也是表达完整思想的重要单位。段落内的句子通常围绕一个主题展开,具有紧密的逻辑关联。将逻辑关联紧密的段落拆分到不同的文本块,可能导致上下文割裂,影响模型对整体语义的把握。

实践建议:

- 段落完整切分:尽量将同一段落的内容保留在同一个文本块中,避免因切分导致的语义断裂。

- 结合主题分割:对于长段落,可以根据主题或语义转折点进行切分,确保每个文本块内部主题统一。

5.2控制文本块长度

5.2.1 设定合理的长度阈值

文本块的长度对向量化模型和大语言模型(LLM)的处理性能有直接影响。过长的文本块可能导致:

- 向量表示稀释:重要的语义信息被淹没,降低检索精度。

- 模型输入限制:超过大模型的输入长度,无法处理全部内容。

过短的文本块则可能缺乏上下文,导致语义不完整。

实践建议:

- 评估模型性能:根据向量化模型和大模型对不同长度文本的处理效果,设定适当的文本块长度阈值。

- 常用长度参考:通常,文本块长度可以设定为 200~500 个字符,根据具体情况调整。

5.2.2 动态调整

不同类型的文本对文本块长度的要求可能不同。灵活调整长度阈值,可以更好地适应多样化的文本内容。

实践建议:

- 文本类型分析:针对新闻、法律文档、技术手册等不同类型的文本,分析其结构特点,设定合适的长度。

- 自适应切分:开发动态调整机制,根据文本内容和结构实时调整文本块长度,实现个性化处理。

5.3重叠切分

5.3.1 方法

重叠切分是指在文本块之间引入一定的重叠部分,使相邻文本块共享部分内容。具体方法是:

- 设定重叠长度:如设定每个文本块之间有 50 个字符的重叠。

- 滑动窗口切分:采用滑动窗口的方式切分文本,每次移动的步长小于窗口大小。

5.3.2 优点

- 保留上下文连接:重叠部分使得相邻文本块之间的上下文信息得到保留,避免因切分导致的语义断裂。

- 增强模型理解:大模型在生成回答时,能够参考前后文信息,产生更加连贯和准确的结果。

实践建议:

- 合理设定重叠量:根据文本特点和模型需求,设定适当的重叠长度,既保留上下文,又不增加过多的冗余信息。

- 效率考虑:注意重叠切分会增加文本块的数量,需权衡处理效率和上下文保留之间的关系。

5.4结合向量化模型性能

5.4.1 适配模型特性

不同的向量化模型(如 BERT、GPT、Sentence Transformers)在处理文本长度和语义信息方面有不同的表现。

实践建议:

- 模型特性研究:深入了解所使用向量化模型的特点,对其在不同文本长度下的性能进行评估。

- 选择合适策略:根据模型的优势,选择短文本或长文本的分块策略。例如,如果模型对短文本的向量表示效果更好,则应倾向于较短的文本块。

5.4.2 优化向量表示

针对长文本可能出现的语义稀释问题,可以采用更高级的向量表示方法。

实践建议:

- 加权平均:对文本中的重要词汇(如关键词、专有名词)赋予更高权重,增强它们在向量表示中的影响。

- 注意力机制:利用注意力机制(Attention)聚焦文本中的关键部分,生成更具代表性的向量。

- 分层编码:对文本进行层次化编码,先编码句子,再编码段落,逐层组合,保持语义结构。

5.5考虑大模型的输入限制

5.5.1 输入长度控制

大语言模型对输入文本的长度有严格限制(如 GPT-3 的最大输入长度为 2048 个标记)。在召回阶段,需要确保选取的文本块总长度不超过模型的限制。

实践建议:

- 统计文本块长度:在将文本块输入模型前,计算其总长度,确保不超出模型限制。

- 截断策略:如长度超出限制,可考虑截断低相关性的内容,保留核心文本块。

5.5.2 优先级排序

不同的文本块对回答的贡献度不同,应根据其与查询的相关性进行排序,优先输入最重要的内容。

实践建议:

- 相关性评分:为每个召回的文本块计算与查询的相关性得分。

- 择优选择:根据相关性得分,从高到低选择文本块,直至达到模型的输入长度限制。

5.5.3 内容精炼

当重要的文本块过长时,可以对其进行压缩或摘要,确保核心信息得以保留。

实践建议:

- 自动摘要:利用摘要模型对长文本块生成精简的摘要。

- 关键句提取:提取文本块中最能代表核心内容的句子,供大模型参考。

优化文本分块策略需要综合考虑语义完整性、文本块长度、向量化模型性能以及大模型的输入限制等因素。通过避免句子拆分、保持段落关联、引入重叠切分、适配模型特性和合理控制输入长度,可以有效提升 RAG 系统的检索效果和大模型回答的质量。

六、实践中的建议

在 RAG(Retrieval-Augmented Generation,检索增强生成)系统的开发和应用过程中,文本分块策略的选择和优化对系统性能和用户体验具有深远的影响。为确保系统能够高效、准确地处理各种文本并生成高质量的回答,以下是一些在实践中值得参考的建议。

6.1 结合业务场景与文本特点

6.1.1 深入理解应用需求

不同的业务场景对文本处理有着独特的需求和挑战。在选择文本分块策略时,首先要充分理解具体应用的目标和要求。

- 专业领域应用:如在法律、医学等专业领域,文本往往包含大量的术语和复杂的句法结构。此时,需要确保文本分块能够保留专业术语的完整性和上下文关联,避免因切分不当导致语义误解。

- 长文档处理:对于需要处理长篇文档的应用,如技术文档、研究报告,应采用能够保持段落和章节结构的分块策略,确保大模型能够理解文档的整体逻辑和主题发展。

- 实时响应场景:在聊天机器人、智能客服等需要实时响应的场景中,文本分块策略需要兼顾处理速度和语义完整性,可能需要在分块大小和计算资源之间寻找平衡。

6.1.2 分析文本的内在结构

不同类型的文本具有不同的结构特征,在选择分块策略时,应充分考虑这些特性。

- 结构化文本:如 HTML、Markdown 格式的文本,具有明确的标签和层次结构。采用针对性的分块方法(如 HTMLHeaderTextSplitter、MarkdownTextSplitter),能够保留文本的结构信息,提升模型的理解能力。

- 非结构化文本:对于散文、对话等非结构化文本,可考虑基于语义的分块方法,利用自然语言处理技术识别句子边界、主题变化点,确保语义的完整性和连贯性。

- 多语言文本:在处理包含多种语言的文本时,需要选择支持相应语言特性的分块工具,并可能需要针对不同语言调整分块参数。

6.2 进行实验验证与评估

6.2.1 多方案对比

实践中,应对不同的文本分块策略进行实验验证,以确定最适合特定应用场景的方法。

- 策略多样性:尝试固定大小切分、基于标点的切分、重叠切分、语义切分等多种策略。

- 工具选择:使用不同的文本切块工具(如 RecursiveCharacterTextSplitter、NLTKTextSplitter、SpacyTextSplitter)进行比较,了解其在具体应用中的表现。

6.2.2 制定评估指标

为客观评估不同分块策略的效果,需要制定明确的评估指标。

- 检索性能:评估向量化和检索阶段的效果,如召回率、准确率、平均检索时间等。

- 生成质量:评估大模型生成回答的准确性、完整性、连贯性,以及与用户查询的相关性。

- 用户反馈:收集用户对系统回答的满意度评价,作为质量评估的重要参考。

6.2.3 数据驱动的优化

基于实验数据和评估结果,对分块策略进行优化。

- 参数调优:根据实验结果,调整文本块长度、重叠长度、分割符等参数,寻求最佳配置。

- 问题定位:通过分析模型错误案例,找出分块策略中导致性能下降的原因,针对性地改进。

- 渐进式优化:采用迭代的方法,逐步改进分块策略和参数设置,每次优化后进行验证,确保优化方向正确。

6.3 持续优化与迭代改进

6.3.1 动态适应系统反馈

在系统运行过程中,持续监控性能指标和用户反馈,及时调整分块策略以适应新的需求和挑战。

- 性能监控:建立监控机制,实时跟踪系统的响应时间、错误率、用户交互量等指标。

- 反馈收集:通过用户评价、问卷调查等方式,了解用户对系统的满意度和需求变化。

- 策略调整:根据收集到的数据,评估当前分块策略的有效性,必要时进行调整,如优化切分规则、引入新的分块方法。

6.3.2 引入先进技术

关注自然语言处理领域的新技术和新方法,将其引入系统以提升性能。

- 新模型应用:例如,随着预训练语言模型的发展,可以尝试采用更先进的向量化模型或生成模型,提升系统的理解和生成能力。

- 自动化工具:利用机器学习和深度学习技术,实现分块策略的自动优化,如通过强化学习自动调整切分参数。

- 跨领域学习:借鉴其他领域的成功经验,如图像处理中的分块策略,可能为文本分块提供新的思路。

6.3.3 团队协作与知识分享

推动团队内部的协作和经验交流,共同提升系统的能力。

- 定期讨论:组织团队成员定期分享在文本分块和模型优化方面的经验和心得,讨论遇到的问题和解决方案。

- 知识沉淀:将实践中积累的经验和教训整理成文档或规范,为后续的开发和优化提供参考。

- 跨团队合作:与其他相关团队(如数据标注、用户研究)协作,获取更全面的视角和支持。

- 结合业务场景:根据具体的应用需求和文本特点,选择最适合的文本分块策略。

- 实验验证:通过实验对不同的分块策略进行评估,观察对检索和生成效果的影响。

- 持续优化:根据系统的反馈和性能指标,不断调整和优化文本分块策略。

文本分块策略的优化是一个持续迭代的过程,需要结合业务场景、文本特点和系统反馈,通过实验验证和数据驱动的方式,不断完善。

七、总结

文本分块策略在RAG系统中具有关键作用,直接影响到向量数据库的构建质量和大模型回答的准确性。合理的分块策略需要在保持文本语义完整性的同时,兼顾向量化模型和大模型的性能限制。选择适合的文本分块方法,需要考虑文本的格式、结构、内容,以及实际的应用场景。

固定大小文本切块方法简单易用,但需要引入改进措施以保证上下文的完整性。基于 NLTK 和 spaCy 的文本切块方法利用了自然语言处理的能力,适用于需要保持句子级别完整性的场景。针对特殊格式的文本,使用专门的切块方法能够有效保留文本的结构信息。基于语义和智能体的文本切块方法虽有较高的技术门槛,但在特定领域和需求下,能够显著提升系统的性能和用户体验。没有一种放之四海而皆准的最佳实践,只有结合具体业务需求和文本特点的定制化方案。

在实际应用中,应该根据具体的需求,结合多种文本分块策略,并通过实验和迭代,不断优化系统的性能。只有充分理解和利用各种文本分块方法,才能充分发挥RAG系统的优势,为用户提供更加准确和高质量的回答。

参考文献:

- Lewis, P., et al. (2020). Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks. Advances in Neural Information Processing Systems, 33, 9459–9474.

- Guu, K., et al. (2020). REALM: Retrieval-Augmented Language Model Pre-Training. Proceedings of the 37th International Conference on Machine Learning, 1-41.

- Chen, D., et al. (2017). Reading Wikipedia to Answer Open-Domain Questions. Association for Computational Linguistics, 1870–1879.

- 《Text Segmentation by Cross Segment Attention》: https://arxiv.org/abs/2004.14535

- 训练实现: https://github.com/aakash222/text-segmentation-NLP/

- 《Sequence Model with Self-Adaptive Sliding Window for Efficient Spoken Document Segmentation》: https://arxiv.org/abs/2107.09278

- ModelScope框架: https://github.com/modelscope/modelscope/

- 《Dense X Retrieval: What Retrieval Granularity Should We Use?》: https://arxiv.org/pdf/2312.06648.pdf

开放原子开发者工作坊旨在鼓励更多人参与开源活动,与志同道合的开发者们相互交流开发经验、分享开发心得、获取前沿技术趋势。工作坊有多种形式的开发者活动,如meetup、训练营等,主打技术交流,干货满满,真诚地邀请各位开发者共同参与!

更多推荐

已为社区贡献31条内容

已为社区贡献31条内容

所有评论(0)