✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,matlab项目合作可私信。

🍎个人主页:Matlab科研工作室

🍊个人信条:格物致知。

更多Matlab完整代码及仿真定制内容点击👇

智能优化算法 神经网络预测 雷达通信 无线传感器 电力系统

信号处理 图像处理 路径规划 元胞自动机 无人机

🔥 内容介绍

在数据科学和机器学习领域,回归预测是一项关键任务。它可以帮助我们预测连续变量的值,从而为决策提供有力的支持。在本篇博文中,我们将介绍基于XGBoost算法实现数据回归预测的方法。

XGBoost是一种强大的机器学习算法,它在许多数据科学竞赛中表现出色。它是一种梯度提升算法,通过迭代地训练多个决策树模型来逐步提升预测性能。与传统的决策树算法相比,XGBoost具有更好的泛化能力和准确性。

首先,我们需要准备我们的数据集。数据集应该包含一些特征(自变量)和一个目标变量(因变量)。特征可以是数值型、分类型或者文本型,但是目标变量必须是连续型的。我们还需要将数据集分为训练集和测试集,以便评估模型的性能:

在构建模型之前,我们还需要将数据集分为训练集和测试集:

# 将数据集分为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)现在,我们可以开始构建我们的XGBoost回归模型了。首先,我们需要定义模型的超参数。XGBoost有许多可调整的参数,如学习率、最大树深度、子样本比例等。我们可以通过交叉验证来选择最佳的参数组合。

# 定义模型的超参数

params = {

'objective': 'reg:squarederror',

'learning_rate': 0.1,

'max_depth': 3,

'subsample': 0.8

}

# 将数据转换为DMatrix格式

dtrain = xgb.DMatrix(X_train, label=y_train)

dtest = xgb.DMatrix(X_test, label=y_test)

# 训练模型

model = xgb.train(params, dtrain, num_boost_round=100)训练完成后,我们可以使用模型对测试集进行预测,并计算预测结果与真实结果之间的均方根误差(RMSE):

# 对测试集进行预测

y_pred = model.predict(dtest)

# 计算均方根误差

rmse = np.sqrt(mean_squared_error(y_test, y_pred))最后,我们可以根据实际需求对模型进行优化和调整。可以尝试不同的超参数组合、特征工程和模型集成等方法来提高预测性能。

总结起来,基于XGBoost实现数据回归预测是一项强大而有用的技术。它可以帮助我们预测连续变量的值,并为决策提供准确的支持。通过使用XGBoost库和一些简单的代码,我们可以轻松地构建和训练一个高性能的回归模型。

希望本篇博文对你理解和应用基于XGBoost的数据回归预测有所帮助。祝你在数据科学和机器学习的旅程中取得成功!

📣 部分代码

function model = xgboost_train(p_train, t_train, params, max_num_iters)

%%% Function inputs:

% p_train: matrix of inputs for the training set

% t_train: vetor of labels/values for the test set

% params : structure of learning parameters

% max_num_iters: max number of iterations for learning

%%% Function output:

% model: a structure containing:

% iters_optimal; % number of iterations performs by xgboost (final model)

% h_booster_ptr; % pointer to the final model

% params; % model parameters (just for info)

% missing; % value considered "missing"

%% 加载 xgboost 库

loadlibrary('xgboost')

%% 设置参数

missing = single(NaN); % 设置该值被视为"缺失"

iters_optimal = max_num_iters; % 最大迭代次数

%% 设置xgboost的相关参数

if isempty(params)

params.booster = 'gbtree';

% params.objective = 'binary:logistic';

params.objective = 'reg:linear';

params.max_depth = 5;

params.eta = 0.1;

params.min_child_weight = 1;

params.subsample = 0.9;

params.colsample_bytree = 1;

params.num_parallel_tree = 1;

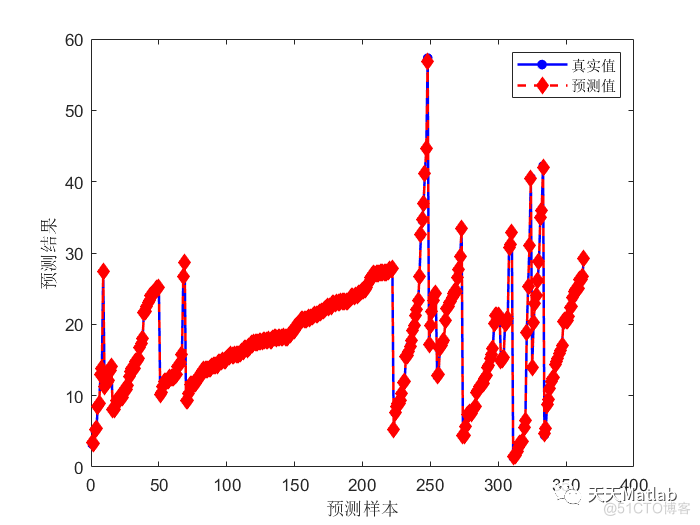

end⛳️ 运行结果

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)