最强AI绘画大模型Flux可以在SDWebUI 上使用了!超便捷的Flux模型使用教程

目前最强的AI绘画大模型Flux.1 横空出世有段时间了,模型效果也得到了广泛的认可,但是 Stable Diffusion WebUI 官方迟迟没有跟进,据说是因为要修改很多底层的处理机制,加之ComfyUI如火如荼,可能AUTOMATIC1111大佬的心气也不是很高,选择了躺平,又或者是在秘密的憋大招。

大家好,我是程序员晓晓

目前最强的AI绘画大模型Flux.1 横空出世有段时间了,模型效果也得到了广泛的认可,但是 Stable Diffusion WebUI 官方迟迟没有跟进,据说是因为要修改很多底层的处理机制,加之ComfyUI如火如荼,可能AUTOMATIC1111大佬的心气也不是很高,选择了躺平,又或者是在秘密的憋大招。

不过在开源的AI绘画界还有另一个大佬,那就是 ControlNet 的作者张吕敏,他搞了一个SD WebUI的衍生版:Stable Diffusion WebUI Forge。Flux发布没多久,Forge就开始了相关的支持工作,虽然目前还有很多特性没有得到支持(这也间接说明WebUI支持Flux的改造难度确实很大),比如ControlNet,但是基本的文生图和图生图已经没有什么问题了,喜欢WebUI的同学可以体验下了。

本地部署

Stable Diffusion WebUI Forge 提供了一个一键安装包:安装包下载请扫描免费获取哦

下载后需要解压,然后进入解压出的文件夹,双击执行 update.bat,将程序升级到最新版本,最后双击执行 run.bat ,启动程序。

其它模型还需要自己手动下载,放到相应的目录中。

使用方法

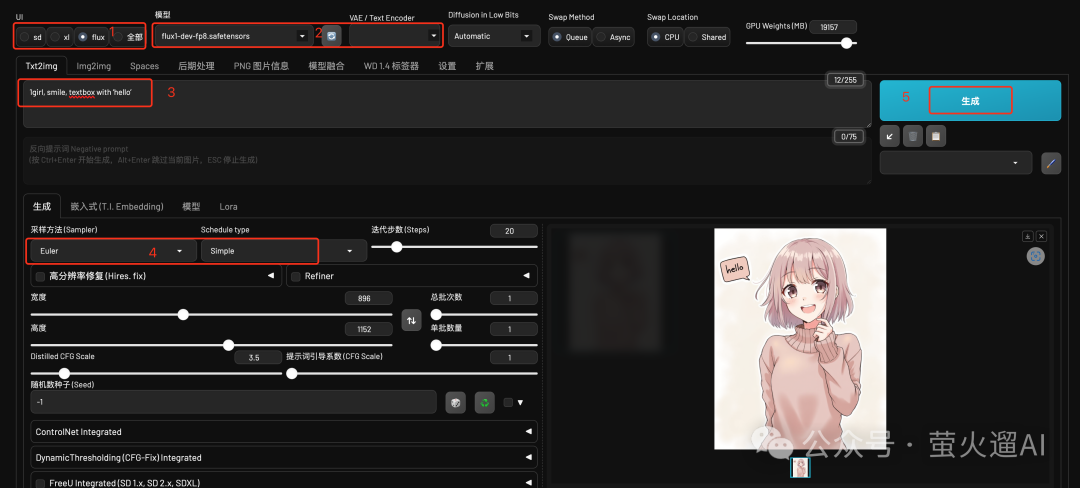

我这里截了一张在Forge中使用Flux生图的操作过程,大家可以有个基本的认识。

下面分步介绍下:

1、UI

选择Flux。选择不同的UI,下边的一些选项会有所变化,比如宽度和高度、提示词引导系数的默认值等等。

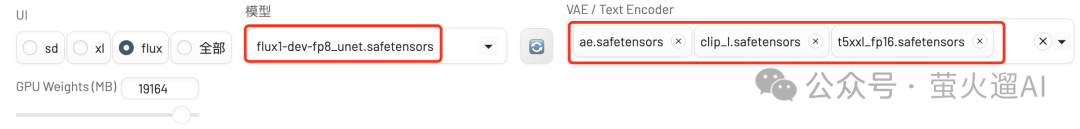

2、模型和VAE/Text Encoder

这里演示用的Flux基础模型自带VAE(潜空间编解码器)和Text Encoder(文本提示词编码器),所以不需要选择VAE/Text Encoder;如果你使用的Flux模型是单独的unet模型,则需要选择VAE和Text Encoder。

Forge支持的Flux基础模型一般有这几种:

-

flux1-dev-bnb-nf4-v2.safetensors 张吕敏大佬搞的unet量化模型。

-

flux1-dev-fp8_unet.safetensors 只包含unet模型。

-

flux1-dev-fp8.safetensors 包含unet、vae和text encoder模型。

这几个模型需要放到 Forge 模型目录的基础模型子目录下。

Forge需要的VAE和Text Encoder模型包括:

-

ae.safetensors Flux使用的VAE模型;

-

clip_l.safetensors 相对传统的文本提示词编码器模型;

-

t5xxl_fp16.safetensors 比较新的文本提示词编码器模型,使用自然语言。

这几个模型需要放到 Forge 模型目录的 vae 子目录下。

这里给出一些模型的搭配组合:

-

flux1-dev-fp8.safetensors

-

flux1-dev-fp8_unet.safetensors + ae.safetensors + clip_l.safetensors + t5xxl_fp16.safetensors

-

flux1-dev-bnb-nf4-v2.safetensors + ae.safetensors + clip_l.safetensors + t5xxl_fp16.safetensors(可选)

3、提示词

只需要正向提示词,Flux目前开放的模型不支持反向提示词。这里演示用的是:

1girl, black hair, smile, a textbox with ‘hello’

4、采样方法和调度器

不是所有的采样方法和调度器都支持Flux。

采样方法我测试了这几个是可以的:

-

DPM++ 2M

-

Euler

-

DPM2

-

[Forge] Flux Realistic(速度快,推荐)

调度器(Schedule type)选择 :Simple、Normal或者SGM Uniform都可以。

5、生成

最后点击生成就可以了,根据机器系统不同,需要的时间会有所差别。

首次生图需要加载模型,可能需要的时间更长一些。

6、其它参数

这里边还有一些其它参数:

-

宽度和高度:可以根据自己的需要进行调整,Flux模型支持的尺寸可以覆盖SD1.5和SDXL支持的尺寸。

-

迭代步数:20-30

-

总批次数:一共生成几次。可以连续生成多次,选择其中最好看的,俗称抽卡。

-

单批数量:每次生成几张图片,比较消耗显存,显存大的话可以设置的多点。

-

Distilled CFG Scale 和 提示词引导系数:这两个都不能设置的很大,默认就可以了,绝大部分情况下不需要调整。

-

随机数种子:每次生成都是用不同的随机数,图片会更加多样化。

环境配置

量化之后的Flux模型需要的显存大幅降低,12G显存就能跑起来。

不过要想实现更好的效果,还得是尽量选择损失比较小的模型。演示用的 flux1-dev-fp8 在资源和质量之间取得了一个平衡,推荐大家使用。

资源下载

文章中使用的Flux模型和程序,都已经上传到我整理的 Stable Diffusion 绘画资源中,需要的小伙伴可以看下方扫描免费获取哦

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

对于0基础小白入门:

如果你是零基础小白,想快速入门AI绘画是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以找到适合自己的学习方案

包括:stable diffusion安装包、stable diffusion0基础入门全套PDF,视频学习教程。带你从零基础系统性的学好AI绘画!

零基础AI绘画学习资源介绍

👉stable diffusion新手0基础入门PDF👈

(全套教程文末领取哈)

👉AI绘画必备工具👈

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉AI绘画基础+速成+进阶使用教程👈

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉12000+AI关键词大合集👈

这份完整版的AI绘画全套学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

开放原子开发者工作坊旨在鼓励更多人参与开源活动,与志同道合的开发者们相互交流开发经验、分享开发心得、获取前沿技术趋势。工作坊有多种形式的开发者活动,如meetup、训练营等,主打技术交流,干货满满,真诚地邀请各位开发者共同参与!

更多推荐

已为社区贡献106条内容

已为社区贡献106条内容

所有评论(0)